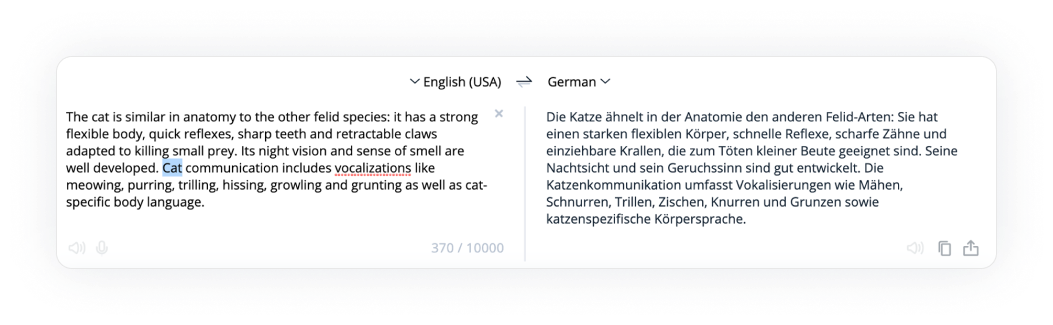

Créez votre propre système de traduction automatique pour tout domaine et tâche de l’entreprise

Boîte à outils de traduction automatique

Préparation des données

Analyser, filtrer, baliser des corpus parallèles et monolingues. Créer des blocs pour les données de test et de validation

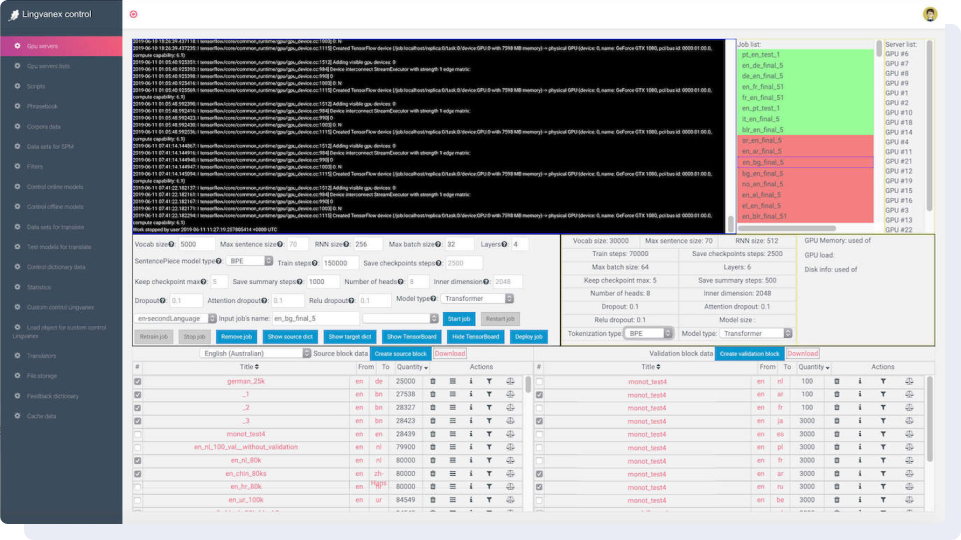

Formation de modèle

Former une architecture neuronale personnalisée avec des listes de tâches parallèles, des analyses GPU et une estimation de la qualité

Déploiement

Lorsque la formation du modèle est terminée, il peut être automatiquement déployé en tant qu’API ou disponible en téléchargement pour une utilisation hors ligne

De novice à Experte

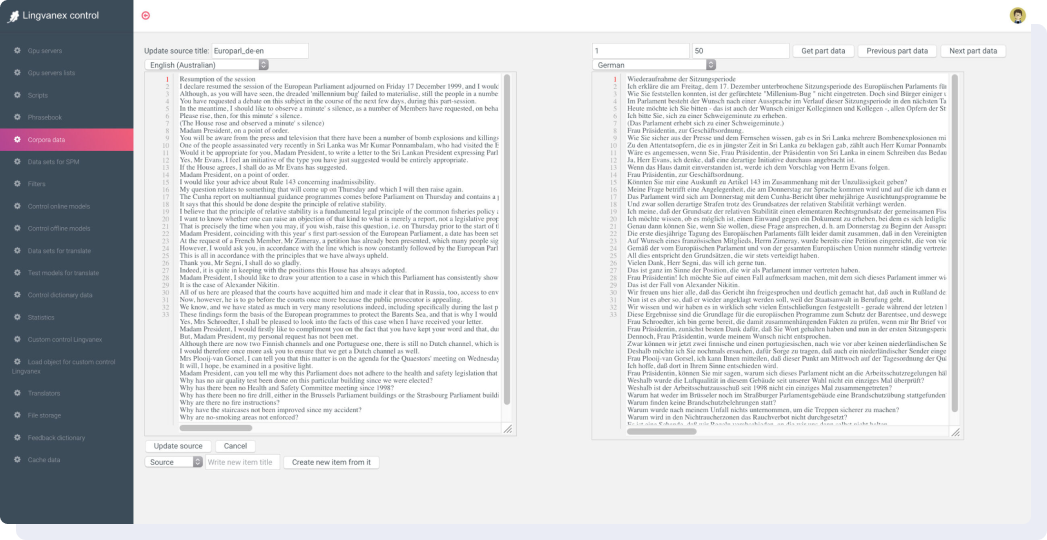

Le tableau de bord combine les dernières techniques linguistiques et statistiques utilisées pour former le logiciel aux domaines des clients et améliorer la qualité de la traduction. Dans l’image ci-dessous : à droite il y a une liste de tâches et de serveurs GPU sur lesquels des modèles sont en cours d’apprentissage. Au centre se trouvent les paramètres du réseau de neurones, et en dessous se trouvent les ensembles de données qui seront utilisés pour la formation.

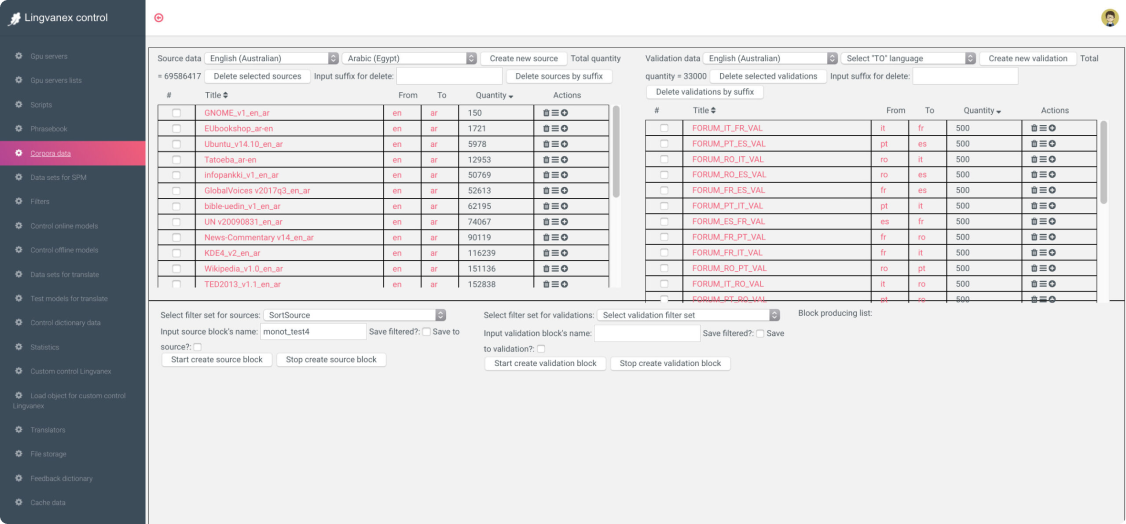

Travailler avec Données parallèles

Le travail sur une nouvelle langue a commencé par la préparation des ensembles de données. Le tableau de bord contient de nombreux ensembles de données prédéfinis provenant de sources ouvertes telles que Wikipedia, le Parlement européen, Paracrawl, Tatoeba et autres. Pour atteindre une qualité de traduction moyenne, 5M de lignes traduites suffisent.

Dictionnaire et Réglage du Tokenizer

Les ensembles de données sont des lignes de texte traduites d’une langue à une autre. Ensuite, le tokenizer divise le texte en jetons et crée des dictionnaires à partir de ceux-ci, triés en fonction de la fréquence de rencontre du jeton. Le jeton peut être constitué de caractères uniques, de syllabes ou de mots entiers. Avec Lingvanex Data Studio, vous pouvez contrôler l’ensemble du processus de création de dictionnaires de jetons SentencePiece pour chaque langue séparément.

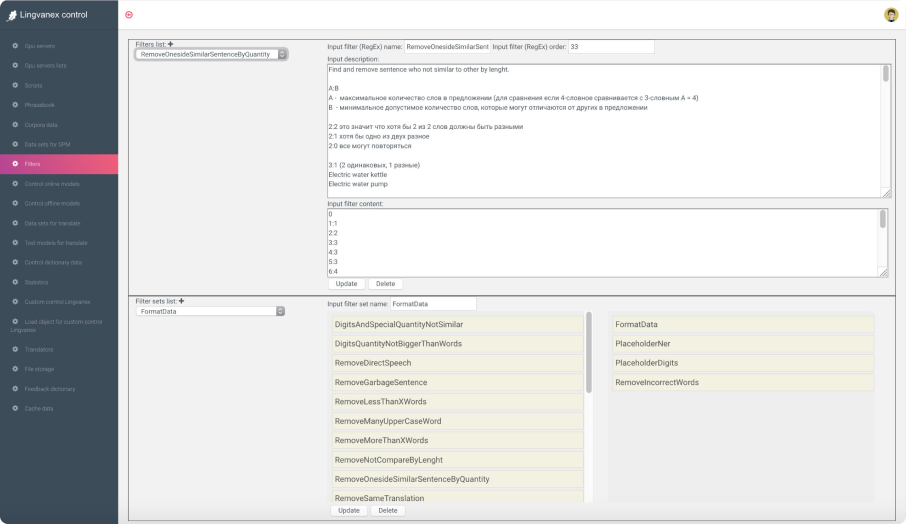

Filtrage des données et Estimation de la qualité

Plus de 20 filtres sont disponibles pour filtrer les corpus parallèles et monolingues afin d’obtenir l’ensemble de données de qualité à partir de données opensource ou analysées. Vous pouvez baliser des entités nommées, des chiffres et tout autre jeton pour entraîner le système à laisser certains mots non traduits ou traduits de manière spécifique.